10月11日,计图(Jittor)团队开发的Jittor神经辐射场算法库JNeRF再次升级。这次JNeRF的改进,包括以下两个方面:

-

新增了4个模型:Plenoxel(CVPR 2022 oral)、NeuS(NeurIPS 2021 Spotlight)、MipNeRF(ICCV 2021 oral, Best Paper Honorable Mention)、PixelNeRF(CVPR 2021);

-

新增了对训练完成的NeRF模型转换为mesh模型的功能。

Part 1

背景介绍

NeRF在2020被提出,它惊艳的视角生成效果获得了学术界的广泛关注。不同于传统的显式表达,NeRF通过将场景表示为隐式的神经辐射场,渲染时通过神经网络查询位置上的场景信息。NeRF被提出以后,许多优秀的工作从不同角度对NeRF进行了改进,而不同方法难以方便地结合,因此NeRF需要一个统一、高效、框架高度适配的模型库,建立统一流程,提升科研效率。

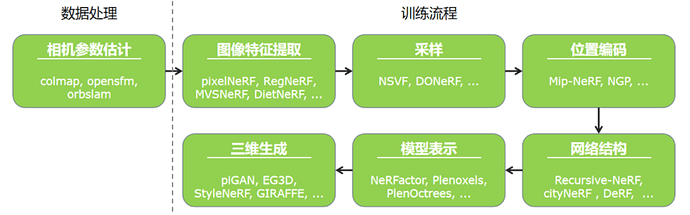

今年6月1日,计图(Jittor)团队发布了Jittor神经辐射场算法库JNeRF[1],JNeRF发布后受到了学界、业界的广泛关注,其开源仓库star已经达到420。JNeRF模型库分析了现有的NeRF方法,将NeRF的主要训练流程总结为以下7个部分,不同部分之间相互解耦,使其能够方便地调用和替换。

图1 JNeRF训练流程

Part 2

新增模型

本次更新JNeRF新增了4个模型:Plenoxel[2]、NeuS[3]、MipNeRF[4]、PixelNeRF[5]。这4个模型都是具有代表性的NeRF工作。

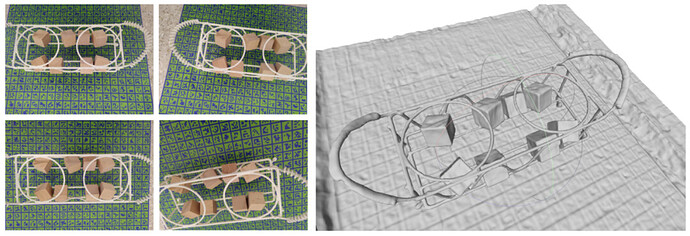

Plenoxel通过完全显式的方式表示辐射场模型,证明了不使用神经网络也能进行NeRF的训练,并极大提升了训练速度。NeuS使用SDF表示物体表面,通过SDF导出密度分布,极大提升了重建结果的几何质量。MipNeRF引入IPE(Integrated Positional Encoding) ,使得光线在对应方向的光锥之中采样,从而提升NeRF性能。PixelNeRF引入2D神经网络挖掘图像的高层次特征,以进行少样本的NeRF训练。

图2 NeuS的展示:训练图像(左),重建模型(右)

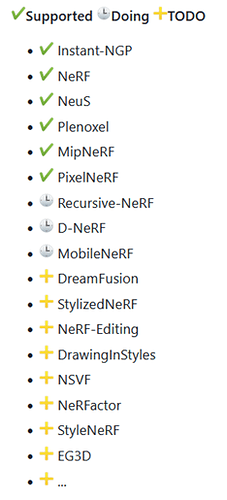

JNeRF目前已支持了6个模型,正在支持3个模型,后续JNeRF仍会对已有的模型进行优化,并不断跟进支持最新的、有价值的NeRF工作。

图3 JNeRF支持的模型

Part 3

NeRF转mesh

为了将重建的NeRF和传统渲染管线更好地结合,本次更新还支持了一键将训练好的NeRF模型转换为mesh模型。转换脚本如下:

python tools/extract_mesh.py --config-file ./projects/ngp/configs/ngp_base.py

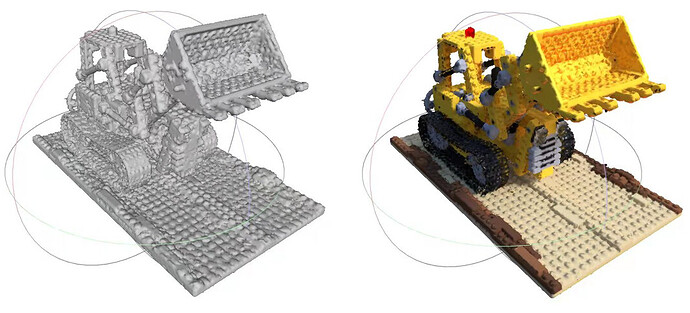

下图给出NeRF模型转换为mesh模型的一个例子。

图4 JNeRF的NeRF模型转mesh模型结果

Part 4

开源贡献者

JNeRF的开源生态发展离不开开发者的贡献,感谢腾讯犀牛鸟开源人才培养计划对JNeRF的支持!

本次更新中来自不同单位的开发者为JNeRF做出了极大贡献,感谢以下开发者!(按姓名拼音排序)

1)李东阳,清华大学计算机系大四本科生,兴趣方向为计算机图形学。

2)刘瑞明,西安交通大学软件学院研究生,兴趣方向为数字图像处理与三维重建。

3)罗子键,就读于中山大学,智能科学与技术专业,现为大三本科生,主要对NLP和多模态三维重建方面的研究感兴趣。

4)彭浩洋,清华大学计图实验室研究生,兴趣方向为计算机图形学。

5)唐龙,青海大学计算机系本科生,热衷于计算机图形学和人工智能相关领域的研究。

6)颜青松,武汉大学测绘学院在读博士生(yanqs_whu@whu.edu.cn),研究方向为基于影像的多视立体几何和网格重建。

7)张嘉瑶,阿卜杜拉国王科技大学图形学硕士,阿美石油高性能实习工程师,字节跳动引擎开发工程师 。

最后,JNeRF仓库还会继续支持更多最新的、有价值的模型,欢迎大家通过该仓库进行NeRF的学习和研究,并和我们一起完善该仓库,共同推动NeRF的发展。

如果大家在使用过程中发现任何问题或者希望一起推动该仓库的发展,请在github提交issue或者pr,也可以加入JNeRF交流群与我们讨论。

参考文献

-

Fridovich-Keil S, Yu A, Tancik M, et al. Plenoxels: Radiance Fields Without Neural Networks, Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2022, 5501-5510.

-

Wang P, Liu L, Liu Y, et al. Neus: Learning neural implicit surfaces by volume rendering for multi-view reconstruction, arXiv preprint arXiv:2106.10689, 2021.

-

Barron J T, Mildenhall B, Tancik M, et al. Mip-nerf: A multiscale representation for anti-aliasing neural radiance fields, Proceedings of the IEEE/CVF International Conference on Computer Vision, 2021, 5855-5864.

-

Yu A, Ye V, Tancik M, et al. pixelnerf: Neural radiance fields from one or few images, Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2021, 4578-4587.

可通过下方二维码,关注清华大学图形学实验室,了解图形学、Jittor框架、CVMJ期刊和CVM会议的相关资讯。