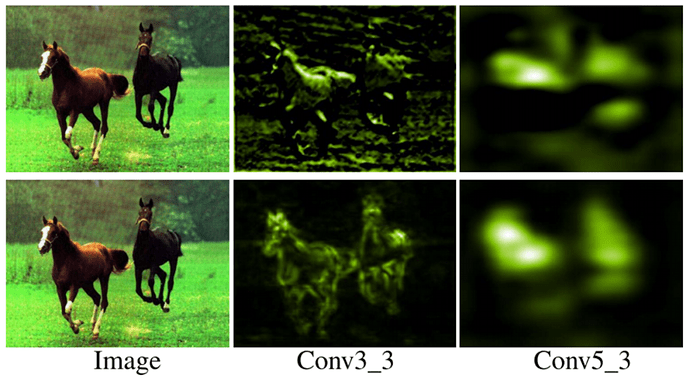

类别激活图是从分类网络中生成的类别响应图,它可以在图像类别标签级标注信息的基础上粗略定位到图像中具有判别性的物体区域。近期,南开大学媒体计算实验室程明明教授团队提出了一种层次化类别激活图的生成方法,称为LayerCAM[1]。已有类别激活图方法,例如Grad-CAM[2]和Grad-CAM++[3],只能从卷积神经网络深层生成可靠类别激活图(如图1上所示)。LayerCAM可以为卷积神经网络的所有层生成可靠的类别激活图。

图1 Grad-CAM(上)和LayerCAM(下)在VGG16[4]不同层生成的类别激活图

Part 1

LayerCAM方法介绍

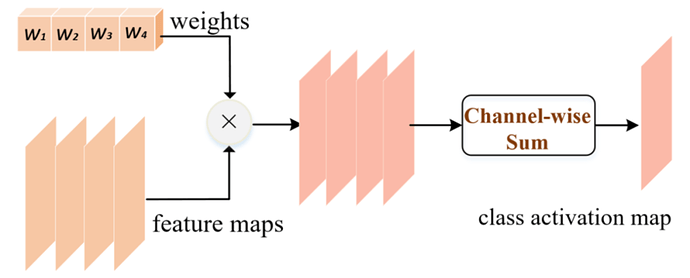

图2 Grad-CAM和Grad-CAM++示意图

如图2所示,Grad-CAM和Grad-CAM++在生成类别激活图的时候为每一个特征图分配一个全局权重,这个全局权重被用于加权平均所有的特征图得到最后的类别激活图。从图1中的Conv3_3层类别激活图可以看出,Grad-CAM和Grad-CAM++不能从卷积神经网络的浅层生成可靠的类别激活图。究其原因,是因为全局权重不能代表特征图中每一个空间位置对于最终类别激活图的贡献,所以他们在浅层生成的类别激活图会有很多噪声。

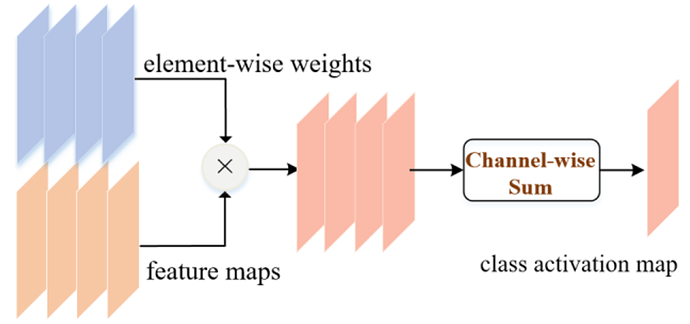

程明明团队提出的LayerCAM在生成类别激活图时采用元素级别权重。如图3 所示,这个元素级别权重可以考虑特征图中每个空间位置的作用。LayerCAM可以应用于任何卷积神经网络的任何层的激活区域定位,是Grad-CAM[2]和CAM[5]的一种延伸。

图3 LayerCAM示意图

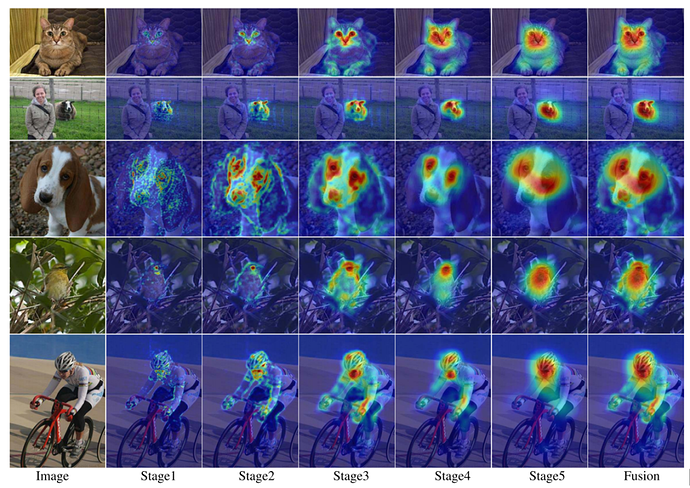

图4给出了LayerCAM生成的类别激活图的定位效果,其中S5-S1表示VGG16每个阶段的最后一个卷积层,Fusion表示S3-S5的类别激活图融合。

图4 LayerCAM生成的类别激活图的定位效果

Part 2

LayerCAM方法的应用

LayerCAM由于可以应用于卷积神经网络的每个层,在多个弱监督任务上都取得了很好的效果。

1. 弱监督物体定位

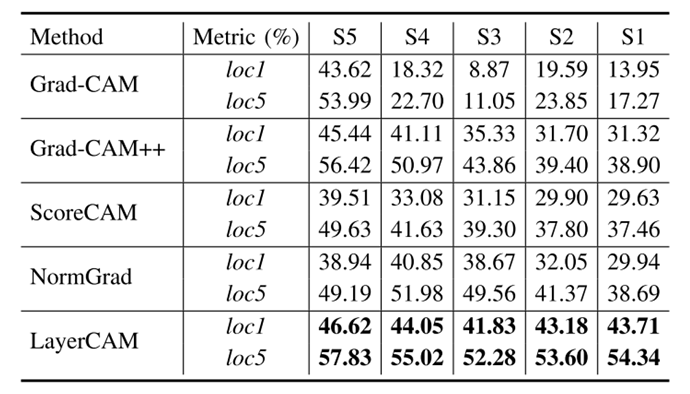

表一给出不同的可视化方法生成的类别激活图的定位效果,S5-S1表示VGG16每个阶段的最后一个卷积层。

表1 不同可视化方法生成类别激活图的定位效果对比

- 工业缺陷检测

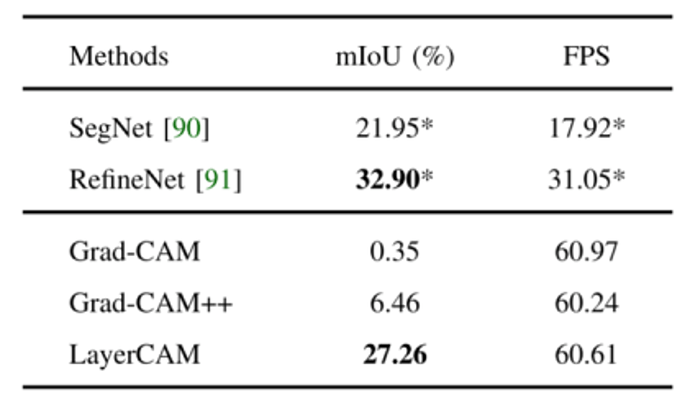

该方法可以应用于工业缺陷检测,检测效果见表2,表中最上面两个方式是强监督方法。

表2 工业缺陷检测效果

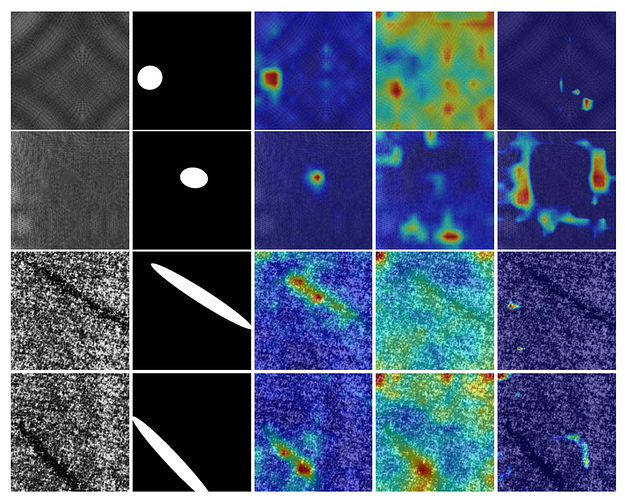

下图给出了工业缺陷检测应用的可视化效果,图中从左到右依次是图像、标签、LayerCAM、Grad-CAM++和Grad-CAM。

图5 工业缺陷检测应用可视化效果

3. 弱监督物体分割

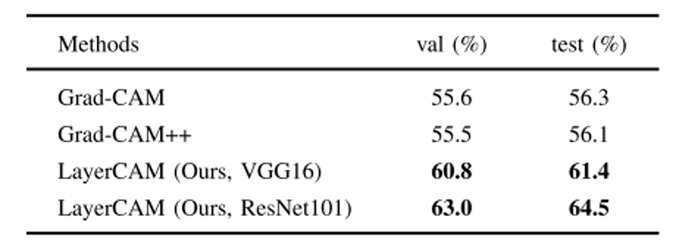

表3给出LayerCAM方法在弱监督语义分割上的结果(PASCAL VOC数据集)。

表3 弱监督语义分割上的应用

Part 3

Jittor开源

计图(Jittor)是清华大学自主研发的深度学习框架,自2020年3月20日发布以来,因为元算子融合和统一计算图的两大创新,在很多应用领域,取得了优于国际主流框架的性能,程明明教授团队近期也开源了基于Jittor框架实现的的LayerCAM。

作者将LayerCAM应用于Jittor库中预训练模型的激活图生成,代码和文章已在GitHub开源:

论文已经在IEEE TIP上发表:

参考文献

-

Peng-Tao Jiang, Chang-Bin Zhang, Qibin Hou, Ming-Ming Cheng, Yunchao Wei, LayerCAM: ExploringHierarchical Class Activation Maps for Localization, IEEE Transactions on Image Processing, Vol. 30, 5875-5888, 2021.

-

Selvaraju, Ramprasaath R., etal.,Grad-cam: Visual explanations from deep networks via gradient-basedlocalization,ICCV 2017,618-626.

-

Chattopadhay, Aditya, et al., Grad-cam++: Generalized gradient-based visual explanations for deepconvolutional networks, IEEE Winter Conference on Applications of Computer Vision, 2018, 839-847.

-

Simonyan Karen and Andrew Zisserman, Very deep convolutional networks for large-scale imagerecognition, ICLR 2014.

-

Bolei Zhou, et al., Learning deep features for discriminative localization, CVPR 2016, 2921-2929.